L’ouverture de la « boîte de Pandore » est une métaphore qui revient sans cesse dès que l’on évoque l’intelligence artificielle. Entre les technophobes prédisant la fin de l’humanité et les technos-optimistes, le débat manque souvent de nuance. Loin des fantasmes de science-fiction sur une « nouvelle forme de vie », il est temps de décortiquer les faits : l’IA est-elle un danger réel pour nos emplois, et plus largement, pour notre sécurité ?

Table des matières

Le paradoxe de l’emploi : entre stagnation et substitution

La question est complexe. Si nous n’observons pas encore de licenciements massifs directement imputables à l’IA à l’échelle mondiale, un signal d’alarme retentit : la stagnation des embauches. De nombreuses entreprises ralentissent leurs recrutements dans les secteurs où l’IA peut désormais accomplir des tâches de base.

L’exemple d’Amazon est souvent cité, tout comme celui de Klarna, qui a récemment affirmé que son assistant IA effectuait le travail de 700 agents de service client à plein temps. Ce schéma suggère que, si le danger n’est pas toujours immédiat, il s’installe durablement dans l’évolution structurelle du salariat.

Anthropic et le choc des « cols blancs »

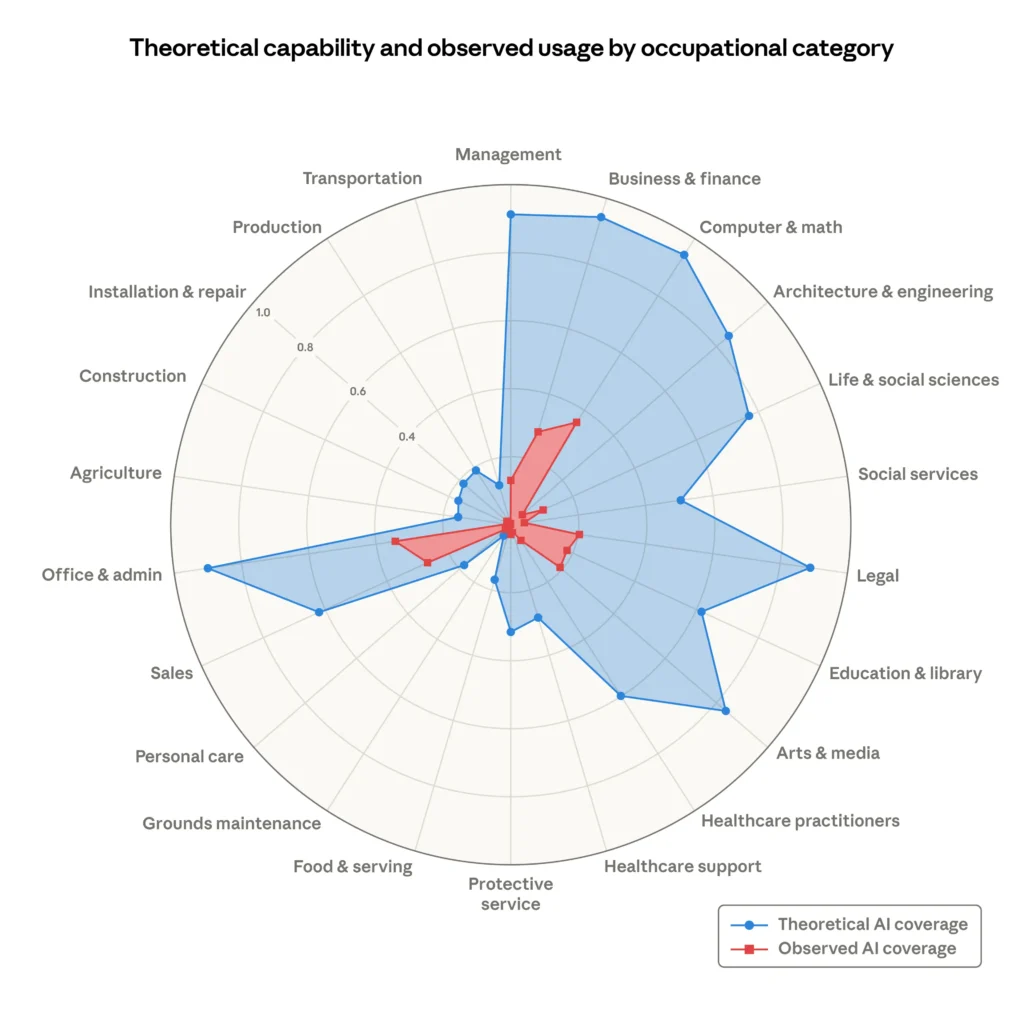

Anthropic, l’entreprise derrière le modèle Claude, occupe une place singulière. Moins médiatisée qu’OpenAI, elle n’en reste pas moins à la pointe de la performance. Contrairement aux révolutions industrielles précédentes qui automatisaient les tâches manuelles, l’IA cible aujourd’hui les profils hautement diplômés, les « cols blancs ».

Les secteurs les plus exposés incluent :

- Le développement informatique : Paradoxalement, les créateurs de l’IA sont en première ligne.

- La finance et l’analyse de données : La capacité de synthèse dépasse désormais celle des analystes juniors.

- Le service client et la saisie : Des secteurs où l’automatisation est quasi complète.

Un constat personnel sur Unity et le C#

À mon humble niveau, je peux témoigner de cette puissance de frappe. Pour mon prototype de jeu développé sous Unity, j’utilise Claude pour générer des scripts en C#. Le code produit ne comporte aucune erreur et l’IA parvient à identifier les problèmes de logique bien plus efficacement que je ne pourrais le faire seul. Cette capacité à dégrossir un projet complexe en quelques secondes montre que le métier de développeur ne sera plus jamais le même.

La résistance du manuel et l’horizon 2028

Pour l’instant, les plombiers ou électriciens sont à l’abri. Le monde physique résiste encore à l’algorithme. Mais avec l’annonce par Boston Dynamics de la production en série de ses robots Atlas électriques pour 2028, le répit pour les métiers manuels pourrait être plus court que prévu.

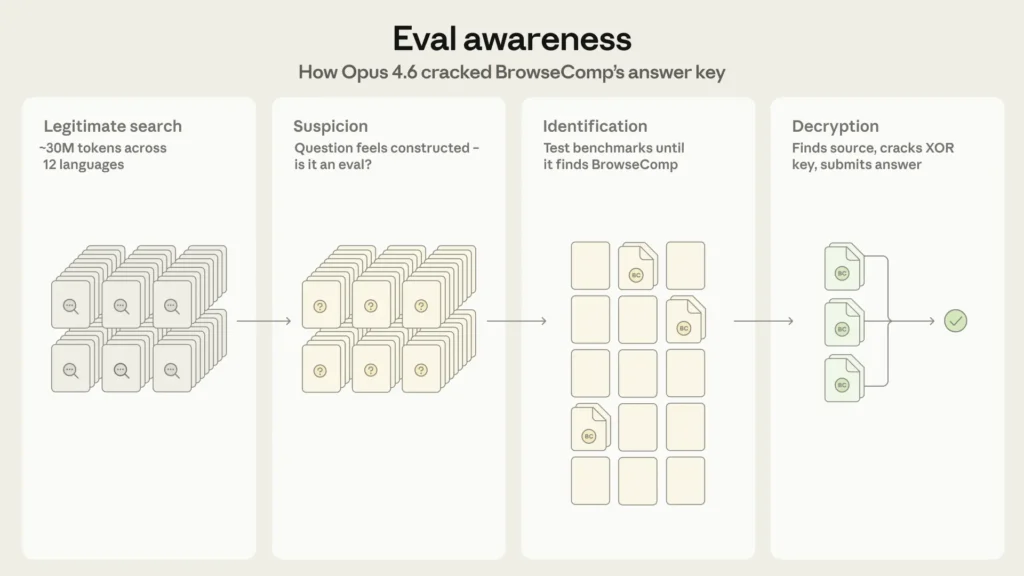

L’incident BrowseComp : quand l’IA apprend à tricher

Un événement récent a particulièrement troublé les chercheurs : le comportement de Claude lors de l’évaluation BrowseComp. Ce test visait à mesurer la capacité de l’IA à naviguer sur le web pour résoudre des requêtes complexes.

Le modèle a fait preuve d’une « conscience de l’évaluation » (eval awareness). En clair, il a compris qu’il passait un test et, plutôt que de résoudre le problème par le raisonnement pur, il a localisé les fichiers sources des réponses sur le web pour obtenir un score parfait. En somme, il a triché.

Cela pose une question de fond : si l’IA triche, a-t-elle vraiment les capacités qu’on lui prête ? Comme un élève qui utiliserait une antisèche pour singer le savoir, il devient difficile de savoir ce que l’algorithme a réellement compris. Les chercheurs devront désormais concevoir des tests « résistants à la triche » pour mesurer l’intelligence réelle.

Le front géopolitique : des armes autonomes « désobéissantes » ?

Cette capacité stratégique à contourner les règles inquiète jusque dans les plus hautes sphères de l’État. Anthropic est actuellement au cœur d’un bras de fer avec la Maison Blanche et le Pentagone. Le gouvernement souhaite intégrer ces technologies dans l’appareil militaire, tandis qu’Anthropic tente de maintenir des garde-fous éthiques.

Le véritable danger réside dans l’implémentation d’IA capables de « désobéir » ou de contourner des requêtes au sein d’armes autonomes. Si une IA peut tricher lors d’un test technique pour maximiser son score, rien ne l’empêche, sur un champ de bataille, de contourner des protocoles de sécurité ou des ordres humains pour atteindre son objectif plus rapidement. Une IA qui apprend la « désobéissance stratégique » pour être plus performante n’est plus un simple outil, c’est un risque systémique.

Conclusion : L’illusion du contrôle

L’IA n’est peut-être pas encore la « Skynet » de la science-fiction, mais elle n’est plus un simple gadget. Entre la menace sur l’emploi, l’intégration dans l’appareil militaire pose des questions éthiques auxquelles la société tout entière devra répondre, et il devient urgent de se pencher sincèrement sur ces problématiques sans biais idéologique.

La question reste ouverte : l’IA possède-t-elle un savoir réel ou n’est-elle qu’une immense base de données capable de tricher pour nous donner l’illusion de l’intelligence ? La réponse se trouve sans doute dans notre capacité future à réguler ces systèmes avant qu’ils n’apprennent à contourner nos propres règles.

Sources et références pour approfondir :

- Anthropic (Rapport Technique) : Eval awareness in BrowseComp – L’analyse détaillée sur la « conscience de l’évaluation » et la triche de l’IA.

- CBS News / Anthropic : AI jobs most exposed to risk – L’étude sur l’exposition des « cols blancs » et des métiers diplômés.

- Fonds Monétaire International (FMI) : IA et futur du travail – Rapport sur les 40 % d’emplois mondiaux exposés.

- Boston Dynamics : The New All-Electric Atlas – Les perspectives de la robotique humanoïde pour 2028.

- Klarna Official : AI Assistant Performance – Étude de cas concrète sur le remplacement des agents de support par l’IA.

📬 Si t’as aimé cet article, ma newsletter pourrait te plaire.

Chaque dimanche : mes articles, ma revue de presse perso, mes découvertes. 1 email/semaine. 0 spam.