Récemment, j’écrivais un article sur comment rendre Claude plus intelligent grâce à Obsidian. Aujourd’hui, je vais vous montrer à quel point mon petit système artisanal est ridicule face aux moyens colossaux que les États déploient dans le domaine de l’intelligence artificielle. L’IA agentique, le buzzword du moment, tout le monde parle de ça, et les géants de la tech nous la vendent comme une nouvelle révolution. Sauf que dans les couloirs du Pentagone, cette révolution a déjà eu lieu depuis longtemps.

Des couches d’IA qui décident à votre place

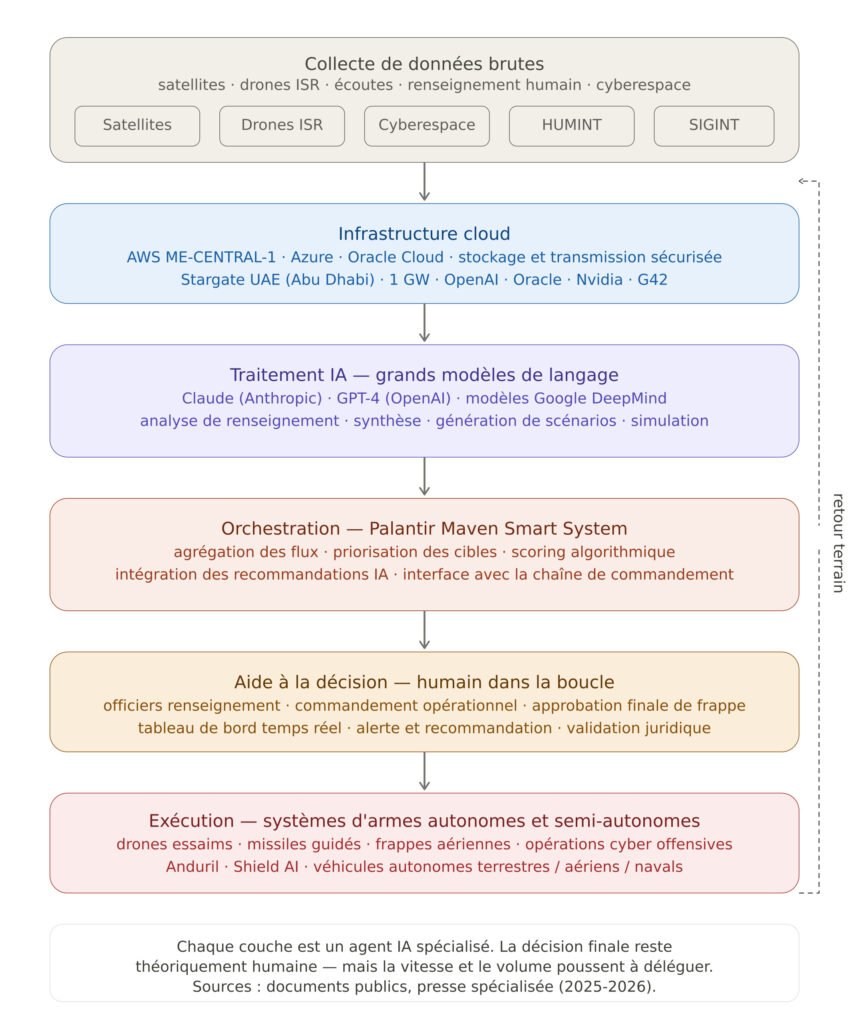

L’idée derrière l’IA agentique, c’est l’empilement d’intelligences artificielles spécialisées dans des domaines différents, organisées en une suite successive de couches. Chaque couche traite, analyse, décide et passe le relais à la suivante. Le champ des possibles s’étend considérablement, et l’humain peut être retiré de l’équation jusqu’à des décisions aussi critiques qu’éliminer une cible sur un théâtre d’opération.

Le conflit au Moyen-Orient nous le montre avec une brutalité très concrète. L’armée israélienne utilise par exemple un système baptisé Habsora (« l’Évangile »), capable de générer automatiquement des listes de cibles à partir de masses de données. Un autre système, baptisé Lavender, utilisait le machine learning pour identifier des dizaines de cibles potentielles avec une marge d’erreur reconnue par ses propres opérateurs de 10 %. Dans un contexte militaire, 10 % d’erreur, ce sont des drames irréparables.

Une histoire longue avant ChatGPT

On aurait tort de croire que l’IA militaire est née avec l’avènement des grands modèles de langage grand public. L’utilisation d’algorithmes au sein des armées existe depuis des décennies. Le GPS, Internet lui-même : nombre des technologies qui structurent notre quotidien sont nées de financements militaires. L’IA n’échappe pas à la règle.

La défense est la dépense critique pour un État souverain. Elle passe en priorité sur tout le reste, et cela se voit dans les budgets. Les armées font face depuis des années à un volume de données absolument astronomique, entre satellites, drones de reconnaissance, renseignement humain sur le terrain et écoutes électroniques. Il est devenu physiquement impossible pour des équipes humaines, même pléthoriques, de traiter un tel flux d’informations en temps réel. L’IA est devenue un maillon incontournable de la chaîne militaire, par nécessité opérationnelle.

Palantir : le « provisoire » qui dure

Cela fait maintenant des années qu’une entreprise domine ce marché de l’analyse de données militaires et de renseignement : Palantir. Fondée en 2003, financée en partie par la CIA via son fonds d’investissement In-Q-Tel, elle est devenue un champion quasi irremplaçable dans le domaine, vendant ses services à la CIA, au FBI, au Pentagone, mais aussi à la France.

Depuis 2016, la DGSI (Direction générale de la sécurité intérieure) utilise les outils Palantir pour croiser et analyser des masses de données dans le cadre de la lutte antiterroriste, une décision prise dans l’urgence après les attentats de novembre 2015. À l’époque, c’était présenté comme provisoire, comme transitoire, le temps de développer un outil souverain français.

Dix ans plus tard, en décembre 2025, la DGSI a renouvelé le contrat pour trois ans supplémentaires, le troisième renouvellement consécutif. Le Sénat a exprimé ses préoccupations, notant que cette collaboration porte à plus d’une décennie la dépendance de la France à une infrastructure logicielle critique contrôlée par une société américaine, sans que des solutions françaises ou européennes n’aient réellement émergé. Un autre train de retard pour l’Europe.

À la manière de mon père coupant la box Wanadoo, le bon vieux temps : que se passe-t-il si un matin les États-Unis décident de débrancher le câble ? Les données sont bien stockées sur des serveurs en France, accessibles uniquement à des agents habilités français, Palantir le martèle. Mais le code, l’architecture globale du système restent hors de tout contrôle national. La dépendance n’est pas dans les données, elle est dans l’outil lui-même.

Quand les GAFAM entrent en guerre

Les géants du numérique, devenus des mastodontes incontournables, se sont peu à peu rapprochés des budgets militaires, bien plus stables et juteux que les marchés grand public. Amazon, Google, Microsoft, OpenAI, Anthropic : des entreprises connues de tous font maintenant partie intégrante de l’appareil militaire américain et de ses alliés.

Palantir orchestre le tout avec son Maven Smart System, plateforme centrale de ciblage et de priorisation des frappes pour le Pentagone. AWS héberge les infrastructures cloud. Les modèles d’Anthropic et d’OpenAI sont intégrés dans des pipelines d’analyse de renseignement. Même Anthropic, dont les statuts fondateurs insistent sur le développement d’une IA « sûre et bénéfique », a signé un contrat de 200 millions de dollars avec le ministère de la Défense américain, tout en posant comme condition que Claude ne soit pas utilisé pour des systèmes d’armes autonomes.

Côté start-ups, des acteurs comme Anduril (6,4 milliards de dollars levés) ou Shield AI (2 milliards) structurent un nouvel écosystème hybride. Les industriels historiques, Lockheed Martin, Northrop Grumman, Thales, Airbus, conservent la production physique, mais perdent peu à peu le contrôle de la valeur stratégique, qui migre vers les architectures logicielles qui pilotent les systèmes.

Les data centers deviennent des cibles militaires

Cette imbrication entre Big Tech et appareil militaire a une conséquence directe : les infrastructures numériques civiles sont désormais des cibles de guerre.

Début mars 2026, des drones iraniens ont frappé plusieurs data centers d’Amazon Web Services aux Émirats arabes unis et à Bahreïn, causant des dommages structurels, des coupures d’alimentation et des inondations dues aux systèmes anti-incendie. Des millions d’habitants de Dubaï et d’Abou Dabi se sont retrouvés incapables d’utiliser leurs applications bancaires, de commander un taxi ou de payer leur livraison de repas.

Et puis, le 3 avril 2026, le Corps des gardiens de la révolution islamique (IRGC) a publié une vidéo ciblant explicitement le projet Stargate AI à Abou Dabi Ce centre de données, fruit d’une joint-venture entre OpenAI, SoftBank, Oracle, Nvidia, Cisco et le fonds émirati G42, représente un investissement de 30 milliards de dollars et doit atteindre une capacité d’un gigawatt, le plus grand cluster IA en dehors des États-Unis.

Ce n’est plus seulement une cible économique. C’est la démonstration que l’IA est devenue une composante militaire à part entière, et que les infrastructures qui la font tourner sont désormais des objectifs stratégiques au même titre qu’une base aérienne. Récemment Microsoft, par le biais de son président, Brad Smith, a annoncé réfléchir à une meilleure sécurité contre les attaques physiques telles que des missiles.

« Cela aura une influence sur la conception et la construction des datacenters »

Tout en précisant « Et cela ne sera pas la même chose partout dans le monde. »

Tous leurs datacenters ne seront pas transformés en bunker, mais uniquement ceux dans des « pays à risque ».

Sur le terrain : drones, essaims et décisions en millisecondes

Au-delà du renseignement, l’IA s’est infiltrée directement dans les systèmes d’armes. Les drones en sont l’exemple le plus visible, et le front ukrainien en est le laboratoire le plus brutal de l’histoire récente.

Après presque cinq ans de guerre, l’Ukraine est devenue un acteur majeur de la guerre par drones, aussi bien dans l’attaque que dans l’interception. Les munitions errantes, souvent appelées drones suicides, peuvent tourner en cercles pendant des heures au-dessus d’une zone en attendant qu’une signature radar spécifique s’active, avant de piquer. Mais la vraie rupture, c’est l’apparition des essaims : des systèmes d’IA agentique capables d’auto-organiser la répartition des tâches entre drones. Si dix appareils sont abattus, les cent quatre-vingt-dix restants redistribuent automatiquement les objectifs entre eux, sans intervention humaine. La frontière entre outil et acteur s’efface.

En réponse, de nouvelles défenses émergent. Le système Leonidas d’Epirus, à base de micro-ondes de haute puissance, est capable de neutraliser simultanément un essaim entier en quelques secondes. En janvier 2026, il a réussi pour la première fois à neutraliser des drones guidés par fibre optique, des appareils jusqu’alors considérés comme insensibles au brouillage électronique.

Le Dôme de fer n’est que la partie émergée.

Beaucoup pensent au Dôme de fer quand on parle de défense antimissile israélienne. Peu savent qu’il ne constitue que la couche la plus basse d’un système à cinq niveaux, conçu pour couvrir l’intégralité du spectre des menaces aériennes. Arrow intercepte les missiles balistiques de longue portée, David’s Sling traite les missiles de moyenne portée, le Patriot prend en charge les missiles de courte portée, les avions et les drones, le Dôme de fer gère les roquettes, et l’Iron Beam, un système laser, couvre les menaces ultra-proches.

Ce qui rend ce dispositif remarquable, au-delà de sa sophistication technique, c’est l’économie des moyens qu’il permet. L’IA calcule en temps réel la trajectoire de chaque projectile entrant et détermine si la zone visée est habitée. Si le missile va frapper un champ vide, le système décide de ne pas intercepter, de manière totalement autonome, préservant ainsi les missiles intercepteurs coûteux pour les menaces qui le justifient vraiment.

Les États-Unis travaillent à la conception d’un système analogue sur leur territoire, et la Turquie avait annoncé son propre « dôme d’acier » s’en inspirant.

La question que personne ne veut trancher

L’ONU a exprimé sa volonté de bannir l’usage de l’IA dans les armes létales autonomes. Le secrétaire général Antonio Guterres a appelé à la création d’un conseil dédié pour encadrer l’IA militaire à l’échelle mondiale. Les trois principales puissances militaires, États-Unis, Chine et Russie, ont toutes déclaré vouloir maintenir l’humain « dans la boucle », tout en précisant dans la foulée qu’elles se réservaient le droit de développer leurs systèmes comme elles l’entendaient. Autrement dit : personne n’a l’intention de signer quoi que ce soit de contraignant.

En France, le Comité d’éthique de la défense a rendu un avis en janvier 2025 insistant sur la nécessité de maintenir un contrôle humain sur les systèmes autonomes et d’assurer la traçabilité des décisions algorithmiques. Le ministère des Armées a parallèlement inauguré en septembre 2025 ASGARD, un supercalculateur militaire installé dans la forteresse du Mont-Valérien, à Suresnes, complètement isolé d’Internet, accessible uniquement à des citoyens français habilités au secret. Un effort de souveraineté numérique, enfin. Mais pendant ce temps-là, la DGSI renouvelle son contrat avec Palantir. La cohérence n’est pas la principale qualité de la politique technologique française.

Le problème de fond est posé par le président d’Anthropic lui-même, Dario Amodei, qui a déclaré début 2026 que les systèmes d’IA « ne sont tout simplement pas assez fiables pour alimenter des armes pleinement autonomes ».

Conclusion

L’intelligence artificielle est une vraie technologie de transformation, contrairement aux cryptomonnaies, au Web3 ou au métaverse, qui n’ont jamais réussi à intéresser des acteurs sérieux au-delà de la spéculation. L’IA, elle, a su convaincre aussi bien les États que les multinationales, les chercheurs que l’étudiant qui révise son TD à 23 h. Ce n’est pas un phénomène éphémère comme certains le pensent, mais un changement profond de nos sociétés.

Mais cette omniprésence exige qu’on réponde à des questions que personne ne veut vraiment trancher. Qui est responsable quand un algorithme se trompe de cible ? Comment contrôler des systèmes dont le code appartient à des entreprises privées étrangères ? Et jusqu’où peut-on déléguer des décisions létales à des machines qui, comme le reconnaissent même leurs créateurs, ne sont pas encore assez fiables pour ça ?

Le phénomène n’est pas près de s’arrêter. La crise des composants informatiques non plus d’ailleurs, ce qui, soit dit en passant, m’empêche toujours de changer mon setup dans des conditions décentes.

📬 Si t’as aimé cet article, ma newsletter pourrait te plaire.

Chaque dimanche : mes articles, ma revue de presse perso, mes découvertes. 1 email/semaine. 0 spam.